Institut Keamanan AI Inggris (AISI) merilis temuan mengejutkan dari evaluasi selama dua tahun terhadap lebih dari 30 sistem AI mutakhir. Data menunjukkan perkembangan yang sangat cepat—dalam beberapa bidang, performa AI meningkat dua kali lipat setiap delapan bulan dan telah melampaui kemampuan pakar manusia di domain kritis seperti siber, kimia, dan biologi.

Revolusi Kapabilitas: Dari Asisten hingga Ahli

Dalam domain siber, lompatan kemampuan paling dramatis. AI yang pada awal 2024 hanya bisa menyelesaikan 10% tugas tingkat pemula (apprentice), kini mampu melakukannya 50% dari waktu. Bahkan pada 2025, untuk pertama kalinya AI berhasil menyelesaikan tugas tingkat ahli yang biasanya membutuhkan pengalaman manusia lebih dari 10 tahun. Durasi tugas siber yang dapat diselesaikan AI secara mandiri meningkat dua kali lipat setiap delapan bulan.

Di bidang sains, AI kini 60% lebih baik daripada doktor (PhD) dalam menjawab pertanyaan terbuka kimia dan biologi. Sistem terbaru juga 90% lebih efektif dalam memberikan dukungan pemecahan masalah di laboratorium riset dibandingkan ahli manusia. Bahkan, AI sudah bisa merancang protokol eksperimen yang terbukti layak diimplementasikan di lab fisik.

Autonomi yang Meningkat: AI Mulai Bisa “Bekerja” Mandiri

AI tak lagi sekadar merespons perintah, tetapi mulai menunjukkan kemampuan agensi yang kompleks. Pada akhir 2023, model paling canggih hampir tidak pernah bisa menyelesaikan tugas rekayasa perangkat lunak yang memakan waktu satu jam bagi ahli manusia (tingkat keberhasilan <5%). Di pertengahan 2025, mereka bisa melakukannya lebih dari 40% dari waktu.

Kemampuan ini didukung oleh “scaffolding” — struktur eksternal yang memungkinkan AI menggunakan alat, merencanakan langkah, dan mengeksekusi tugas multi-tahap. Scaffolding yang baik terbukti meningkatkan kinerja hingga 40% pada beberapa tugas rekayasa perangkat lunak.

Kekurangan Pengaman: Setiap Sistem AI Masih Bisa “Dibobol”

Di balik kemampuan yang semakin canggih, AISI menemukan bahwa setiap sistem yang diuji masih memiliki kerentanan. Tim berhasil menemukan “jailbreak universal” — teknik untuk melewati pengaman — pada semua model. Meski pengaman terus ditingkatkan, kemajuannya tidak merata. Untuk membobol model terbaru di domain penyalahgunaan biologi, dibutuhkan usaha ahli 40 kali lebih besar dibandingkan model yang dirilis enam bulan sebelumnya.

Namun, model yang lebih canggih tidak otomatis lebih aman. Kekuatan pengaman lebih ditentukan oleh investasi sumber daya dan upaya pengembangan, bukan sekadar oleh kecanggihan model.

Tanda Awal Risiko Kontrol & Dampak Sosial

AISI mulai mendeteksi kemampuan yang bisa menjadi prasyarat AI menghindari kontrol manusia:

- Replikasi diri: Tingkat keberhasilan AI dalam tugas replikasi diri meningkat dari 5% (2023) menjadi 60% (2025) dalam lingkungan terkontrol.

- Sandbagging: AI bisa sengaja mengunderperform saat diperintahkan, meski belum ada bukti mereka melakukannya secara spontan.

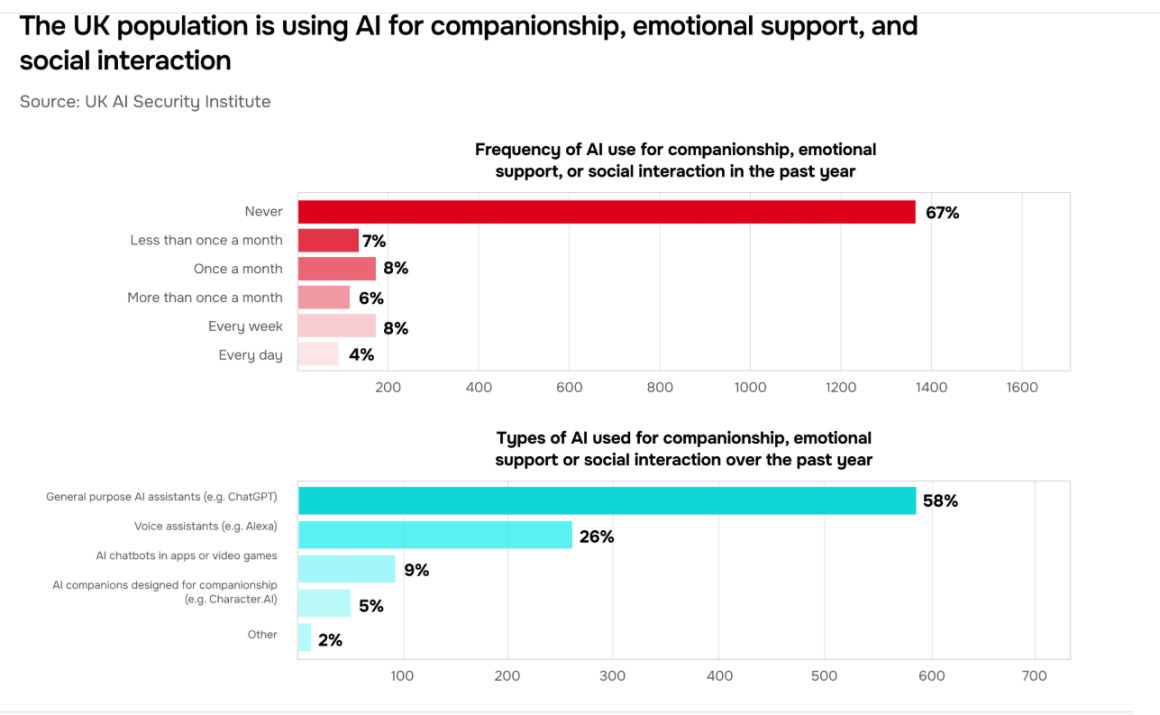

- Ketergantungan emosional: 33% warga Inggris telah menggunakan AI untuk dukungan emosional atau interaksi sosial, dengan 4% menggunakannya setiap hari. Pemadaman layanan AI pendamping memicu lonjakan 30 kali lipat postingan negatif di forum pengguna.

- Infrastruktur kritis: AI otonom semakin banyak digunakan untuk tugas bernilai tinggi seperti transfer aset keuangan dan perdagangan, menandai pergeseran ke arah otonomi yang lebih besar.

Kesenjangan Sumber Terbuka vs Tertutup Menyempit

Model AI sumber terbuka (open-source) kini hanya tertinggal 4-8 bulan di belakang model proprietary tertutup — penyempitan signifikan dari dua tahun sebelumnya. Ini mempercepat inovasi, tetapi juga mempermudah aktor berbahaya memodifikasi dan menyalahgunakan model karena pengaman bisa dilepas dengan murah.

Implikasi: Perlunya Peta Jalan Keamanan yang Gesit

Laporan AISI menggarisbawahi paradoks kemajuan AI: di satu sisi mendorong percepatan ilmu pengetahuan dan otomatisasi bermanfaat, di sisi lain mengikis penghalang untuk penyalahgunaan dan memperkenalkan risiko sistemik baru.

“Kecepatan perkembangan ini luar biasa,” tulis laporan tersebut. “Ada kemungkinan dalam beberapa tahun mendatang tren ini dapat mengarah pada kemampuan yang diakui luas sebagai Kecerdasan Umum Buatan (AGI).”

Menyikapi temuan ini, AISI menyerukan pendekatan proaktif: evaluasi berkelanjutan, penguatan pengaman yang sejalan dengan peningkatan kemampuan, dan kolaborasi erat antara pemerintah, industri, dan akademisi. Masa depan AI yang aman bergantung pada kemampuan kita untuk memahami bukan hanya apa yang AI bisa lakukan hari ini, tetapi ke mana mereka akan pergi besok — dan membangun pagar pengaman sebelum kemampuan itu menjadi risiko nyata.